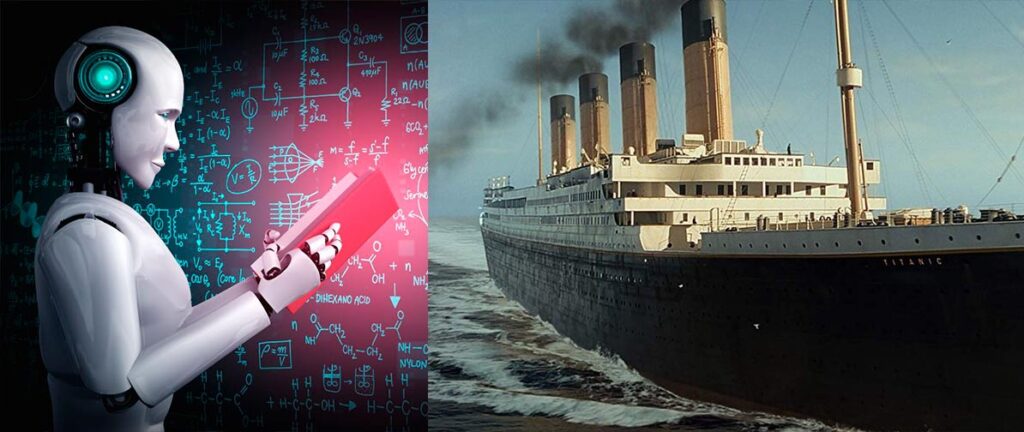

A OpenAI, uma das principais empresas no desenvolvimento de inteligência artificial, tem sido alvo de controvérsias desde sua ascensão, e agora um ex-membro da companhia adiciona mais combustível ao debate sobre os riscos dessa tecnologia. William Saunders, ex-integrante da equipe de superalinhamento da OpenAI, fez declarações contundentes comparando o desenvolvimento da IA ao desastre do Titanic — um progresso marcado pelo excesso de confiança e por uma potencial tragédia à espreita.

Durante uma entrevista, Saunders, que trabalhou diretamente na criação do ChatGPT, criticou a postura da empresa em relação à segurança da IA e afirmou que as consequências dessa abordagem poderão ser sentidas em até três anos.

O “Titanic da inteligência artificial”

Saunders passou três anos na OpenAI e esteve envolvido no desenvolvimento de modelos avançados de IA. No entanto, há um ano, ele deixou a empresa citando preocupações com a forma como os riscos da tecnologia estavam sendo gerenciados.

“A OpenAI está demonstrando o mesmo excesso de confiança que os construtores do Titanic tinham em suas medidas de segurança,” afirmou Saunders. “Eles acreditam que tudo está sob controle, mas, na realidade, não há garantias de que conseguiremos evitar um desastre.”

O especialista aponta que o rápido avanço da IA tem sido impulsionado mais por interesses comerciais do que por preocupações com segurança. Segundo ele, a falta de uma estrutura regulatória eficiente pode transformar o que hoje parece ser um grande avanço em uma ameaça concreta para a sociedade.

O que preocupa o ex-engenheiro da OpenAI?

Entre os principais riscos citados por Saunders está a influência da IA em áreas críticas, como eleições e mercados financeiros. “Já temos estudos que mostram como modelos avançados, como o GPT-4, conseguem enganar humanos em jogos estratégicos. Agora imagine o impacto disso em processos democráticos ou na economia global,” alerta.

Ele também aponta que a OpenAI e seu CEO, Sam Altman, estão priorizando a busca por avanços tecnológicos e vantagens comerciais em detrimento da segurança e da pesquisa ética. “Estamos acelerando em direção a um futuro onde a IA pode manipular informações de maneiras que a sociedade ainda não está preparada para detectar,” reforça.

O futuro próximo: um ponto sem retorno?

Saunders acredita que, se nada mudar, os efeitos negativos da IA começarão a ser sentidos nos próximos três anos. Para ele, a falta de regulamentação e a busca incessante pelo avanço tecnológico sem medidas de controle podem colocar a sociedade diante de desafios sem precedentes.

Você também deve ler!