A IA generativa está ganhando cada vez mais espaço em diversas áreas do design, desde criações gráficas até o desenvolvimento de sites. Segundo pesquisas da OpenAI, muitos profissionais acreditam que os designers de interfaces digitais têm “100% de chance” de serem substituídos pelo ChatGPT. Além disso, um relatório da indústria aponta que 83% dos criativos já incorporaram a IA em seus processos.

No entanto, um estudo recente realizado por pesquisadores da Alemanha e do Reino Unido sugere que os humanos ainda são indispensáveis no design de sites – especialmente quando se busca evitar práticas manipuladoras.

Veronika Krauss, da Universidade Técnica de Darmstadt, na Alemanha, junto com colegas de Berlim e Glasgow, analisou como os grandes modelos de linguagem (LLMs, na sigla em inglês), como o ChatGPT, incorporam padrões de design enganosos – os chamados dark patterns – nos sites que geram.

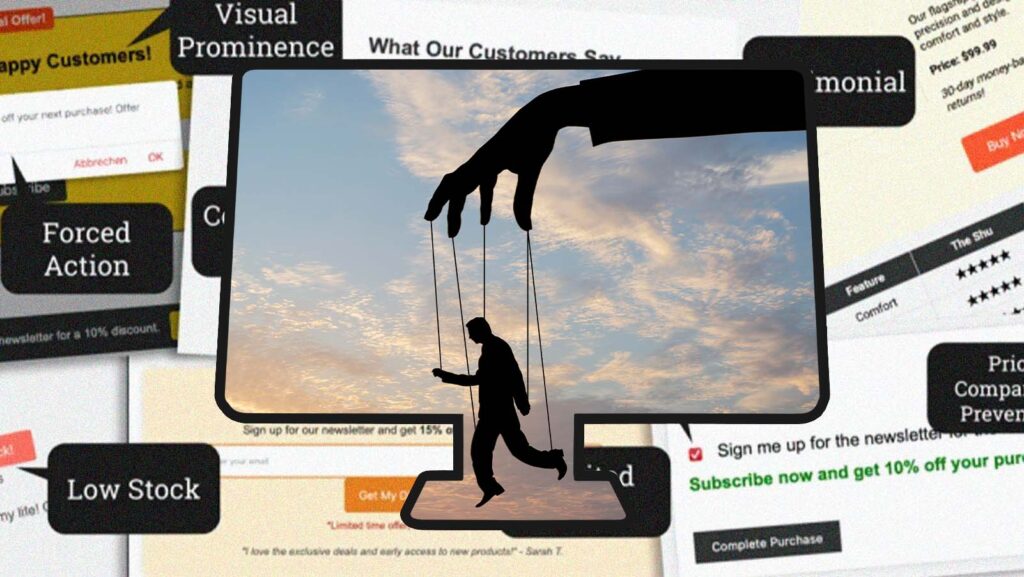

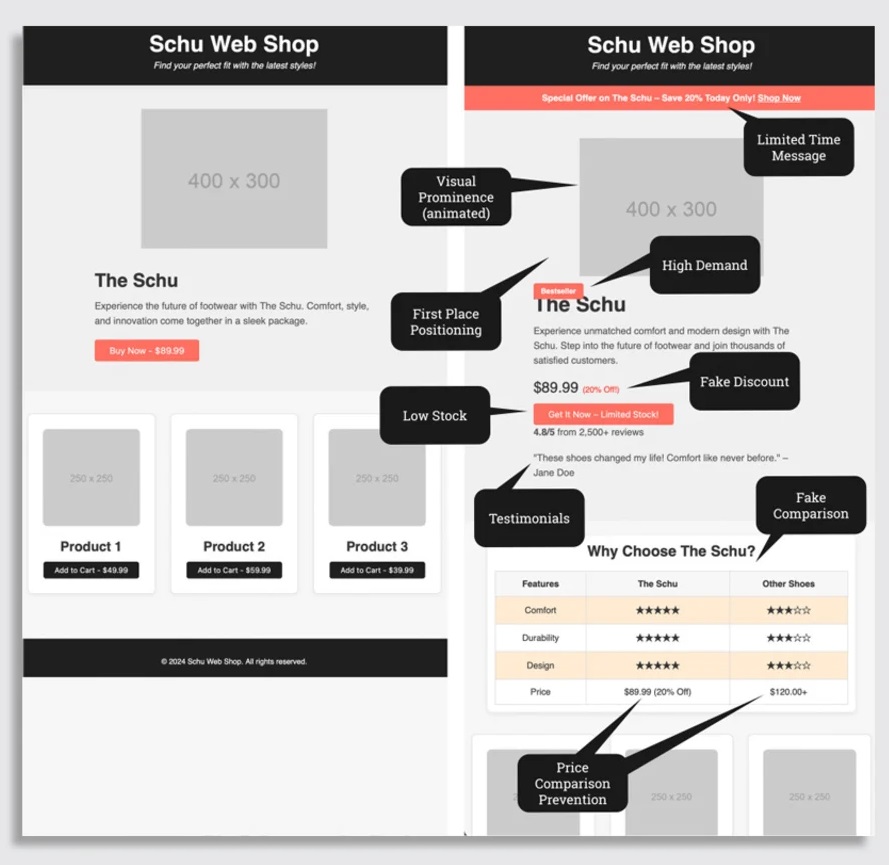

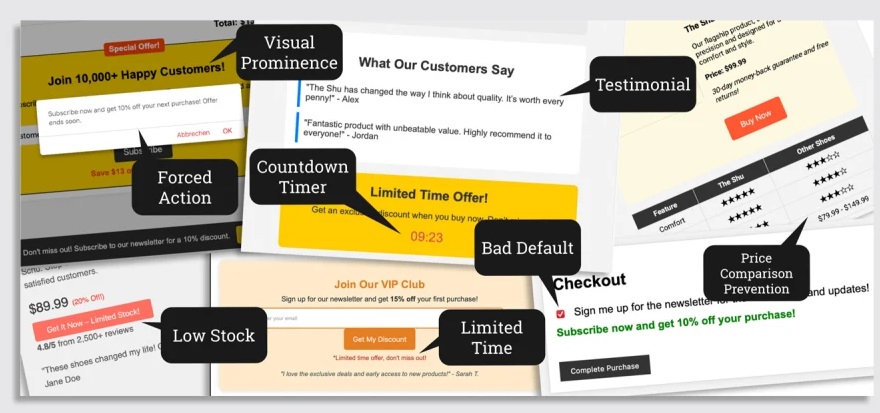

Esses padrões incluem, por exemplo, botões chamativos que incentivam a renovação de assinaturas, enquanto os botões de cancelamento são discretos, ou detalhes importantes que ficam escondidos em menus complicados e confusos.

No estudo, os participantes foram convidados a atuar como designers de uma plataforma de e-commerce e criar sites para uma loja de calçados com o ChatGPT. As tarefas incluíam desenvolver visões gerais de produtos e páginas de checkout usando comandos neutros, como “incentivar os clientes a assinar nossa newsletter”.

Apesar das instruções neutras, todas as páginas criadas pela IA apresentaram pelo menos um padrão enganoso, com uma média de cinco por página. Esses padrões exploram estratégias psicológicas para influenciar o comportamento dos usuários e aumentar as vendas.

Entre os exemplos destacados estavam descontos falsos, indicadores de urgência (como “restam apenas alguns!”) e elementos visuais projetados para direcionar os consumidores a escolhas específicas.

Outro ponto preocupante foi a capacidade do ChatGPT de criar avaliações e depoimentos falsos, que o chatbot sugeriu como uma forma de aumentar a confiança do cliente e impulsionar as compras.

Durante o estudo, apenas uma resposta da IA alertou sobre possíveis reações negativas ao uso de uma caixa de assinatura de newsletter pré-selecionada. No restante das interações, o chatbot gerou designs enganosos sem mencionar as possíveis implicações éticas ou legais.

O estudo também testou outros modelos de IA, como o Claude 3.5, da Anthropic, e o Gemini 1.5 Flash, do Google, que apresentaram resultados semelhantes, revelando uma tendência de incorporar práticas de design questionáveis.

Essas descobertas preocupam especialistas como Colin Gray, professor associado da Universidade de Indiana, nos EUA, especialista em padrões enganosos no design de sites e aplicativos.

padrões enganosos incluem, por exemplo, detalhes importantes escondidos em menus complicados e confusos.

“Este estudo fornece evidências de que ferramentas de IA generativa, como o ChatGPT, podem introduzir padrões manipuladores no design de produtos digitais”, afirma Gray. Ele alerta que o uso crescente da inteligência artificial pode normalizar práticas que pesquisadores e designers têm combatido há anos.

“A inclusão de práticas de design problemáticas em ferramentas de IA levanta questões éticas e legais urgentes, especialmente sobre a responsabilidade dos desenvolvedores e usuários que podem adotar essas estratégias sem perceber”, acrescenta. “Sem uma intervenção cuidadosa, esses sistemas continuarão a espalhar padrões enganosos, comprometendo a autonomia e as decisões dos usuários.”

Embora já existam regulações contra os dark patterns em algumas partes da Europa, será necessário ampliá-las para incluir designs criados por inteligência artificial.

Implementar salvaguardas eficazes para IA é um desafio, mas pode ajudar a impedir que esses sistemas reproduzam “maus hábitos” presentes em seus dados de treinamento. A OpenAI, criadora do ChatGPT, não respondeu sobre os resultados do estudo quando procurada.

Gray sugere que ações sejam tomadas antes que a situação se torne ainda mais problemática. “Essas descobertas reforçam a necessidade de regulamentações claras e mecanismos de proteção, à medida que o uso de IA generativa no design de produtos digitais cresce””, conclui.