A geração aumentada de recuperação (RAG) torna as consultas mais inteligentes, munindo-as com dados proprietários e conhecimento contextualizado. Mas mesmo os melhores métodos RAG produzem respostas imprecisas e janelas de contexto poluídas por dados ruidosos. O Advanced RAG surgiu para corrigir isso.

O RAG não é um método único — há várias maneiras de aumentar a precisão e a confiabilidade dos resultados do LLM com esta estrutura. Este guia cobre as técnicas avançadas de LLM RAG que as equipes usam na produção.

Por que o RAG básico é insuficiente?

RAG básico às vezes é chamado RAG ingênuo devido à sua natureza simples. Ele indexa um conjunto de documentos por meio de um único vetor denso e, em seguida, os incorpora, recupera as K principais correspondências e as passa para um LLM.

O RAG simples em sistemas LLM funciona bem em alguns cenários, mas muitas vezes apresenta dificuldades no uso no mundo real. Aqui estão algumas limitações comuns:

- Memória ruim: Não possui informações suficientes para responder à consulta dentro do mesmo domínio, por isso fornece respostas imprecisas ou incompletas.

- Alucinações: Ele recupera informações insuficientes ou ruidosas e fornece respostas sem suporte.

- Meio ignorado: Prioriza o início e o fim de uma consulta, levando à omissão do contexto relevante quando os pedaços são longos.

- Pouco conhecimento do domínio: Não é adaptado a domínios de conhecimento específicos, pelo que o LLM devolve dados sem nuances importantes.

- Superficialidade: Ele não possui dados suficientes para satisfazer a consulta, então ele retorna os dados que possui e cria uma saída repetitiva.

O Naive RAG não é totalmente confiável na forma como recupera, estrutura e gera dados. As técnicas avançadas de RAG são projetadas especificamente para resolver essas lacunas.

Técnicas avançadas de RAG com LLMs

Indo além do básico, o RAG não é uma simples atualização – você precisa descobrir onde algo deu errado no Gasoduto RAG. Aqui estão técnicas para corrigir problemas antes, durante e depois da recuperação.

Técnicas de pré-recuperação e indexação de dados

A limpeza dos dados na fase de indexação melhora o processo antes da primeira consulta. Vamos dar uma olhada em alguns métodos de pré-recuperação.

Aumente a densidade da informação usando LLMs

LLMs são uma maneira rápida de pré-processar dados. Eles podem criar resumos, aumentar a densidade de informações removendo redundâncias e elaborar questões hipotéticas relevantes para documentos. Ao transformar texto bruto em formatos otimizados, você garante que o sistema de recuperação apresente informações essenciais, e não bobagens.

Agrupamento de dados

Você pode usar o agrupamento RAG para processar seções de dados em vez de documentos inteiros. Não há uma maneira única de executar isso — tanto pedaços grandes quanto pequenos podem melhorar a recuperação. Você também pode implementar métodos exclusivos, como janelas deslizantes e fragmentação hierárquica. LangChain’s O divisor de texto recursivo é um ponto de partida amplamente utilizado, dividindo automaticamente parágrafos, frases e caracteres.

RAG de autoconsulta

Enriquecer um pedaço com metadados – como autor, tópico e carimbo de data/hora – é conhecido como RAG de autoconsulta. Essa técnica pode melhorar a relevância e a atualidade das informações em tempo de execução.

Técnicas de recuperação

Mesmo documentos bem indexados não retornarão respostas de alta qualidade se a recuperação falhar. Use as técnicas a seguir para melhorar seu processo de busca.

Pesquisa híbrida

Este método combina a nuance contextual da pesquisa de vetor denso com a precisão exata da pesquisa de palavra-chave de vetor esparso. Ele considera a frase exata e as relações entre os conceitos, proporcionando melhores resultados do que qualquer uma das técnicas isoladamente. Com o n8n, as equipes podem criar um único fluxo de trabalho usando os dois métodos.

Reescrita e expansão de consultas

Como os usuários nem sempre escrevem prompts perfeitos, essa técnica reformula ou expande sua consulta em termos de pesquisa detalhados. Isso ajuda o sistema a encontrar as informações corretas sem esperar que cada usuário faça perguntas complexas.

Recuperação em vários estágios

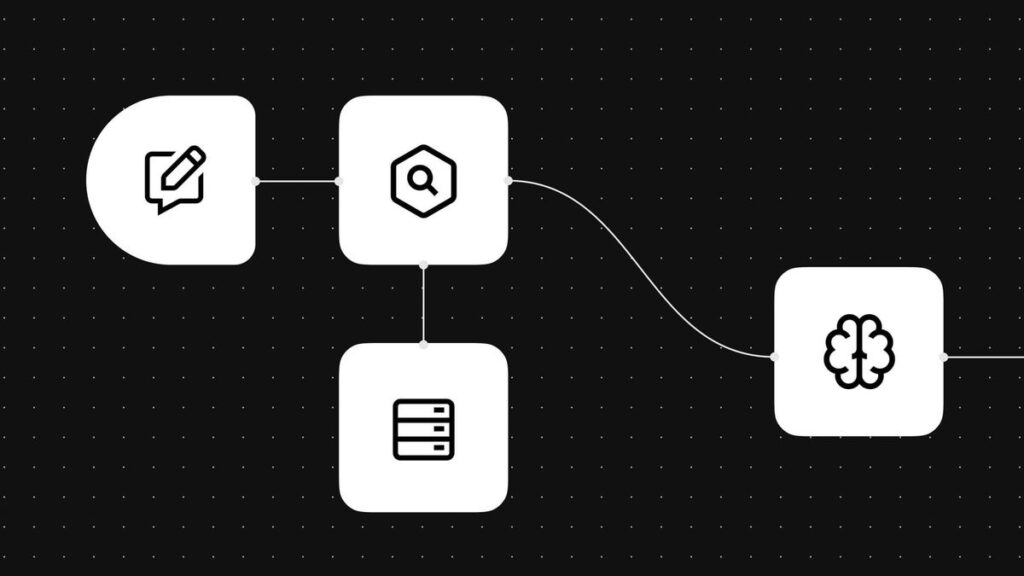

Em vez de depender de uma única passagem de recuperação, esta abordagem analisa os dados em camadas, começando com uma rede ampla e restringindo gradualmente a pesquisa. n8n fluxos nó por nó execute esta técnica facilmente. Ele é executado sequencialmente, com cada nó passando seus resultados para o próximo, aprimorando a saída final.

Gráfico RAG

Em vez de revisar trechos de texto isolados, esse método mapeia como as palavras se conectam conceitualmente. Ao visualizar as relações semânticas como uma web, o sistema pode compreender o “quadro geral” e fornecer um contexto mais profundo e preciso.

RAG multi-salto

Quando um único documento não contém toda a história, essa abordagem permite que o sistema conecte os pontos entre múltiplas fontes. Ao “saltar” de uma informação para outra, ele pode reunir uma resposta abrangente para uma questão complexa.

Técnicas pós-recuperação

Essas técnicas são a etapa final, organizando os resultados antes de o LLM apresentá-los. Aqui estão alguns a serem considerados.

Reclassificação

Depois que uma pesquisa exibe uma lista de possíveis correspondências, um modelo especializado dá uma segunda olhada para classificá-las por relevância. Isso serve como uma verificação final de qualidade, colocando a melhor resposta no topo. Reclassificadores do n8n analise automaticamente as nuances da consulta em relação aos resultados, sempre usando primeiro a saída mais relevante.

Compressão de prompt contextual

Isso reduz o tamanho do prompt, removendo informações irrelevantes e concentrando-se nos detalhes mais valiosos. Isso mantém o foco da conversa, acelera as respostas e reduz drasticamente os custos.

RAG Corretivo

Em vez de se contentar com uma resposta de qualidade inferior, o sistema faz uma pausa para avalie seu trabalho antes de responder. Se o primeiro resultado parecer errado, a IA aciona uma etapa de avaliação para refinar e corrigir os erros, garantindo que a resposta final seja o mais confiável possível.

Citação e verificação da fonte

Isso permite que o sistema verifique os fatos, vinculando cada reivindicação ao material de origem original. Se a afirmação não for suportada, a IA remove ou corrige as informações sem regenerar completamente a saída.

Fusão de contexto

Às vezes, as pesquisas retornam diversas informações sobrepostas de diferentes fontes. Essa técnica os combina em um resumo único e coeso antes que a IA gere a resposta final. Ao mesclar diferentes ângulos em uma única resposta coerente, o sistema reduz o “ruído” e produz resultados mais confiáveis.

💡

Os nós de fluxo de trabalho de IA da n8n suportam todo o pipeline RAG: desde a fragmentação e incorporação na ingestão, passando pela pesquisa híbrida e recuperação em vários estágios, até a reclassificação e compactação contextual antes da resposta final. Cada estágio é um nó visível no fluxo de trabalho, facilitando o teste, a troca e a depuração de técnicas individuais sem reconstruir o pipeline.

Tendências futuras do RAG: IA agêntica e multimodal

O RAG está se afastando dos modelos de implantação linear. A pesquisa aponta para sistemas que fundem recuperação, geração e raciocínio de maneiras mais dinâmicas e adaptativas.

Um dos principais modelos RAG é a IA agente. Sistemas agentes não confie no fluxo fixo tradicional do RAG, dando-lhe uma abordagem mais humana. Os agentes de IA orquestram o processo dependendo da situação, usando ferramentas, validando dados de múltiplas fontes e corrigindo-se ao longo do caminho.

Os agentes de IA podem até ajustar sua estratégia. Eles não decidem apenas a ordem dos processos RAG – eles determinam quais etapas são necessárias e podem até omitir as desnecessárias.

Outra tendência é a IA multimodal, que são sistemas que informam resultados indo além do processamento apenas de texto. Eles recuperam e processam vários tipos de dados ao mesmo tempo, incluindo áudio, imagens e vídeo. Esses modelos entendem as consultas em um nível muito mais profundo. Por exemplo, uma IA pode extrair informações de um manual de solução de problemas e de uma captura de tela do cliente para diagnosticar um problema de TI.

Construa um RAG melhor com n8n

Alcançar melhores resultados começa com a identificação de onde os sistemas falham e como colmatar as lacunas. Raramente existe uma solução única para todos — o sucesso vem do ajuste do seu pipeline à medida que seus casos de uso evoluem. Mas uma abordagem adaptativa e iterativa é tão boa quanto as ferramentas que você usa.

n8n ajuda a coordenar os modelos de IA, bancos de dados de vetores e projetos de prompt que tornam possíveis padrões eficazes. Ele usa um intuitivo camada de orquestração para conectar técnicas RAG em toda a recuperação de dados – desde a ingestão e fragmentação até a reclassificação e geração de respostas. n8n tem mais de 1.000 integrações para conectar todos os estágios do seu pipeline.

Comece gratuitamente com n8n e construir e manter um pipeline RAG estável.

Compartilhe conosco

Os usuários n8n vêm de uma ampla variedade de origens, níveis de experiência e interesses. Procuramos destacar diferentes usuários e seus projetos em nossas postagens de blog. Se você trabalha com n8n e gostaria de inspirar a comunidade, entre em contato conosco 💌